在不暴露敏感数据的情况下保护GenAI

AI工具加速生产力。Netwrix确保它们不会暴露您的敏感数据。

受信任的

生成性人工智能超越传统权限的限制,重用敏感数据,极大地扩展了企业风险表面,使组织面临无法控制的访问和数据丢失。

对敏感数据的无控制AI访问

GenAI 工具可以访问和重用云和本地环境中的受监管和机密数据,通常没有明确的可见性或政策保护措施。

身份扩张加剧了人工智能风险

Over-permissioned users, guest accounts, service accounts and stale identities dramatically expand the blast radius when AI tools surface data.

遗留权限并不是为GenAI构建的

隐藏的访问路径、配置错误和过多的权限使得AI能够暴露比最初预期的更多数据。

对AI驱动活动没有可见性

如果没有对提示、数据使用和异常行为的实时监控,敏感信息可能会在安全团队反应之前被暴露、共享或外泄。

用例

通过减少敏感数据暴露来确保AI安全

在AI之前发现敏感数据

持续扫描文件服务器和云存储库,以识别受监管的、机密的和对业务至关重要的数据,防止协同驾驶员或LLM访问和重用这些数据。

使用AI意识上下文对数据进行分类

应用高保真分类以检测语义敏感性、法律策略、知识产权和受监管内容,以便AI系统尊重商业和合规边界。

减少过度曝光的数据访问

识别各个存储库中过多、继承的和过时的权限,然后修复风险访问路径,以在AI放大暴露之前缩小爆炸半径。

对AI数据实施最小权限

根据业务需求调整访问权限,使用自动化的权限审查、及时特权和身份上下文,以防止敏感数据集被广泛或意外地访问AI。

防止敏感数据在LLM提示中丢失

检测并阻止粘贴到公共AI工具中的受监管或机密内容,从而减少意外泄漏、影子AI滥用和AI驱动的数据外泄。

监控并应对由AI驱动的风险

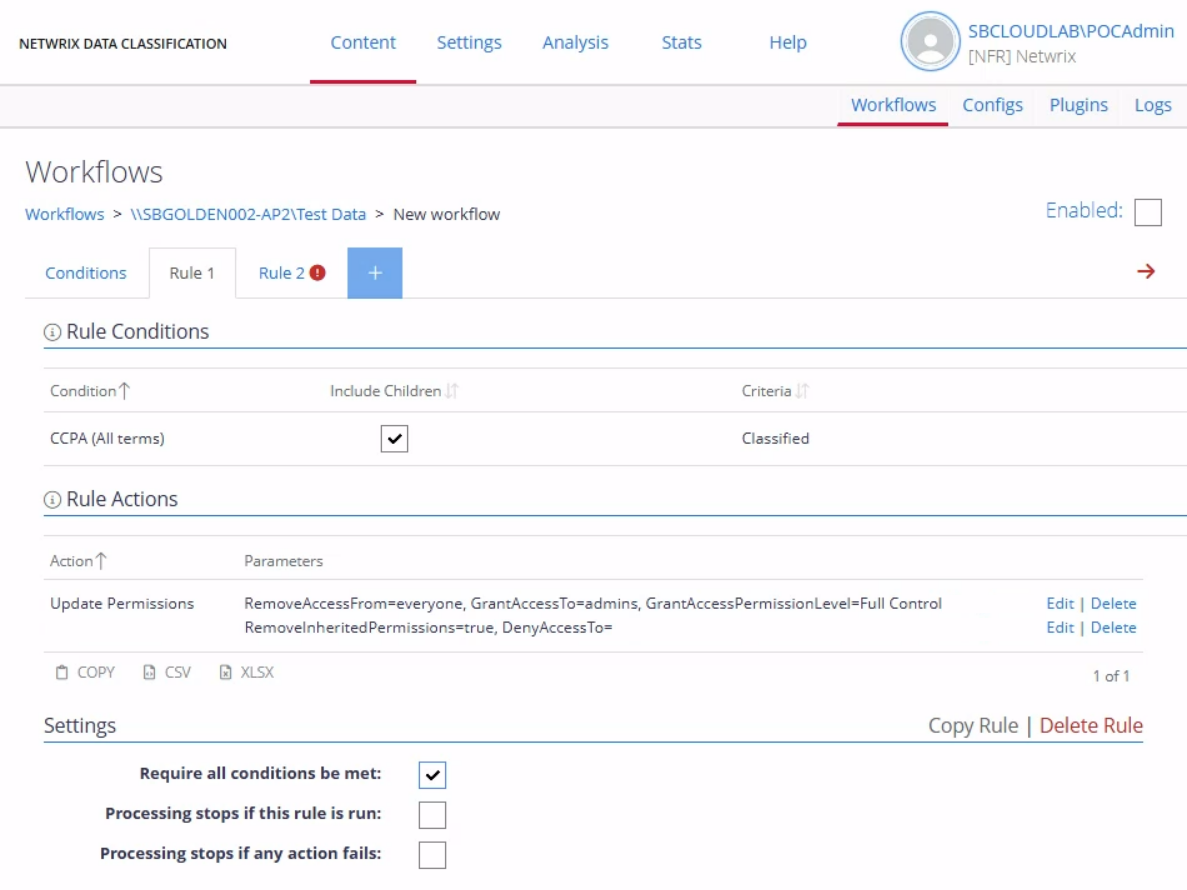

关联数据敏感性、身份活动和异常访问模式,以便及早检测到风险AI行为,并触发自动化的隔离和修复工作流程。

提供AI治理的功能

Netwrix 方法

在人工智能放大风险之前控制敏感数据

为什么选择Netwrix进行AI治理?

生成性人工智能正在改变企业IT,但它也以遗留权限从未设计的方式重用敏感数据。结果是CISO面临的风险表面大幅扩大。Netwrix通过暴露敏感和影子数据、揭示风险访问并在AI放大之前减少数据暴露,确保了GenAI的采用。

准确了解GenAI可以访问的内容

在本地和云环境中发现、分类和编目敏感和受监管的数据(PII、PCI、PHI、IP),并应用标签和政策,以便GenAI仅使用经过批准的数据。

理解和控制由AI驱动的风险

清晰地了解身份的有效访问,理解GenAI的爆炸半径,并在数据暴露之前准确定位高风险用户和账户。

识别过多的权限、错误配置和隐藏的访问路径,并减少不必要的访问,以便GenAI无法显示超过预期的数据。

持续监控并停止风险AI使用

实时监控GenAI交互和身份活动。在提示或外部共享中标记和阻止敏感数据,并对大规模访问、横向移动或风险权限等异常情况发出警报。